醫院DeepSeek安全防御體系構建指南:從Ollama漏洞看智能診療系統風險治理

國產大模型DeepSeek在醫療領域的本地化部署呈現爆發式增長,短短一個月內就有上百家醫院部署了DeepSeek。伴著這股勁風,大型語言模型快速進入了臨床決策支持、電子病歷分析、醫學影像解讀等核心場景。

然而,近期曝光的Ollama一系列高危漏洞(CVE-2024-39719/39720/39721/39722)為醫療機構敲響了警鐘,該系列漏洞中,CVSS評分最高的8.2,最低的7.5分,均屬于高危級別。國家網安部門數據顯示,超過60%的Ollama用戶因未及時更新系統而面臨風險。

Ollama作為大模型本地部署的核心工具,因其便捷性成為DeepSeek部署的重要抓手——用戶通過Ollama的RESTful API接口,可快速完成模型加載、推理服務配置等操作。數據顯示,超過89%的DeepSeek-R1本地化部署案例依賴Ollama框架。

1 漏洞解剖:醫療AI系統的脆弱性圖譜

DeepSeek廣泛落地的背后,開源工具鏈的安全隱患逐漸浮出水面。Ollama的安全缺陷已導致多起醫療AI系統安全事故。醫療AI系統面臨的三重安全困境:模型完整性危機、患者隱私泄漏風險、醫療決策可靠性威脅。

1.1 醫療系統服務癱瘓

黑客可通過漏洞發送特殊指令讓醫院服務器"宕機",從而引發相關系統癱瘓,醫療業務無法正常運轉,甚至全面停擺。

1.2 模型資產失竊風險

攻擊者通過未授權API訪問,可在30秒內竊取價值百萬的預訓練醫學模型。攻擊者利用默認開放的11434端口,可以完整獲取臨床數據的微調參數。某企業就曾因此遭黑客入侵,30秒時間內被盜取了價值百萬的AI模型。

1.3 診療決策污染威脅

通過惡意數據注入可系統性改變模型輸出結果。例如:在測試環境中,攻擊者將"阿司匹林禁忌癥"參數篡改后,模型對消化道出血患者的用藥建議錯誤率提升了43%。

1.4 隱私數據泄露鏈式反應

未受保護的通信鏈路可能成為HIPAA違規導火索。例如:2024年美國AI醫療公司Confidant Health的服務器配置錯誤,泄露了5.3TB的敏感心理健康記錄,給眾多用戶帶來困擾。

2 醫療AI場景下的安全風險自測

Ollama 0.1.47版本已經修復了該漏洞,如果你的版本低于0.1.47,請抓緊時間修補漏洞。

3 縱深防御體系構建方法論

在醫療AI系統面臨多維度安全挑戰的當下,構建縱深防御體系已成為守護患者安全、保障醫療服務連續性的戰略防線。本方法論基于"基礎設施-模型-監測"三重防護閉環,深度融合零信任架構與醫療合規要求,打造從網絡邊界到算法內核的全鏈路安全屏障。

3.1 基礎設施防護層

網絡隔離:基于零信任架構劃分模型訓練域、臨床推理域,參照GB/T 43696-2024《網絡安全技術零信任參考體系架構》。

端口管控:改造默認服務端口,參照國內規范《網絡端口使用管理制度》。

傳輸加密:采用國密算法(SM2/SM4)及WAPI協議,如需兼容國際環境,需要同時兼容FIPS 140-2認證的量子安全通信協議。

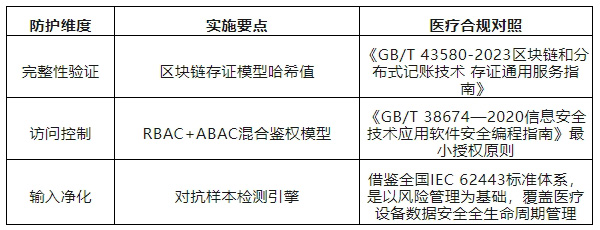

3.2 模型安全防護層

3.3 監測響應層

在監測響應層面,醫院需要構建"基線-情報-熔斷"的閉環防御機制。

首先通過持續采集模型正常狀態下的特征權重分布、輸出置信度等關鍵指標,建立動態更新的行為基線,運用SHAP值分析法監測特征權重波動。

其次,接入醫院信息安全共享平臺,密切關注AI系統安全風險。同時定期跟蹤暗網交易、漏洞利用、異常訪問等多源威脅情報網絡,實現威脅特征實時更新。

最后,建立熔斷機制。當檢測到診斷建議離散度超過15%或監測指標突破預設閾值時,立即觸發熔斷機制,自動將異常模型隔離至沙箱環境,阻止錯誤決策影響臨床系統,并向安全運營中心發送告警信息,形成"監測-決策-響應"的自動化防御鏈條。

4 醫療AI安全加固實踐指南——三步筑牢安全防線

第一步:立即升級系統

在Windows和mac的OS上,Ollama系統都會自動下載更新;Liunx系統則需要手動執行命令完成Ollama系統更新:

第二步:設置安全屏障

任何陌生人來訪,均需通過三道關卡:

1. 網絡隔離:使用防火墻讓Ollama服務僅限內部訪問。

2. 雙重認證:添加白名單(門禁)和賬號密碼認證(門鎖),本文使用Nginx作為示例,讀者可根據實際情況自行調整。

2.1 設置"小區門禁"(IP白名單),就像給小區設置刷卡門禁,只允許指定IP訪問:

2.2 添加"雙重門鎖"(賬號密碼+HTTPS),相當于在防盜門再加密碼鎖:

配置小貼士:

創建密碼文件(在服務器執行):

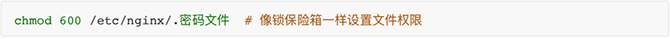

權限設置:

端口改造:修改默認11434端口為自定義端口,相當于把大家都知道的大門封住,只走自己知道的別的門。

修改Ollama配置文件(默認位于/etc/ollama/config.json),將默認的11434端口換成其他端口:

第三步:禁用危險功能(可選)

為醫療AI場景部署多重防護機制,給關鍵敏感操作上把"智能鎖":

關閉模型上傳/下載接口;

設置每分鐘最多5次問答請求;

記錄所有異常訪問日志。

5 真實案例復盤與啟示

某科技公司因致命疏忽未修改設備初始配置,相當于為黑客敞開數字世界的大門。攻擊者僅通過最基礎的端口掃描,便精準定位到暴露的11434高危端口——這道未設防的"電子城門"直通企業核心數據庫。入侵者如入無人之境,不僅竊取了包含客戶隱私和商業機密的完整對話記錄,更通過注入惡意指令序列,使運行中的智能模型瞬間陷入"認知崩塌"狀態,輸出混亂數據導致生產系統全面癱瘓。這場精準網絡打擊造成的直接經濟損失超過500萬元,而事后安全審計揭示,僅需執行常規系統升級即可阻斷99%的攻擊路徑,將損失扼殺于萌芽。

這起事件暴露出企業安全體系存在致命漏洞,本應固若金湯的數字堡壘,竟因基礎防護的缺失淪為黑客的"提款機"。

6 構建全鏈路安全屏障,護航醫療AI穩健前行

漏洞是"照妖鏡":Ollama事件折射出開源工具鏈的脆弱性,任何便捷性都可能伴隨風險敞口,醫療機構需建立持續漏洞掃描與應急響應機制;

合規是"生命線":從零信任架構到區塊鏈存證標準,醫療AI安全需與國家政策同頻共振,將技術防護融入合規框架;

防御是"動態戰":熔斷機制、對抗樣本檢測等創新手段,需與威脅情報網絡形成攻防閉環,構建自適應的安全進化能力。

在此呼吁全體醫信同仁:

醫療機構應立即開展安全自查,實施端口改造與雙重認證,升級Ollama至0.1.47版本以上,截至目前最新版本是0.6.2;技術廠商需強化模型魯棒性測試,建立全生命周期風險管理;監管部門應加快制定醫療AI安全認證標準,形成"技術+管理+政策"三位一體防護網。唯有如此,方能讓醫療AI真正成為提升診療效率的"智能助手",而非威脅患者安全的"數字炸彈"。

(作者單位:云南省腫瘤醫院)

首 頁

首 頁